پرسشی که از زمان افلاطون ذهن فیلسوفان را مشغول کرده بود ـ اینکه دانش ذاتی است یا آموختنی ـ حالا به حوزهی هوش مصنوعی کشیده شده است. گروهی از پژوهشگران دانشگاه کمبریج با طرح مسئلهی معروف «دو برابر کردن مساحت مربع» برای چتجیپیتی، تلاش کردند دریابند آیا این سامانه صرفاً پاسخهای از پیش موجود را بازتولید میکند یا توانایی بداههپردازی و استدلال دارد. این مسئله که نخستین بار ۲۴۰۰ سال پیش در نوشتههای افلاطون مطرح شد، یکی از نمونههای کلاسیک در بحث درباره منشأ دانش به شمار میرود.

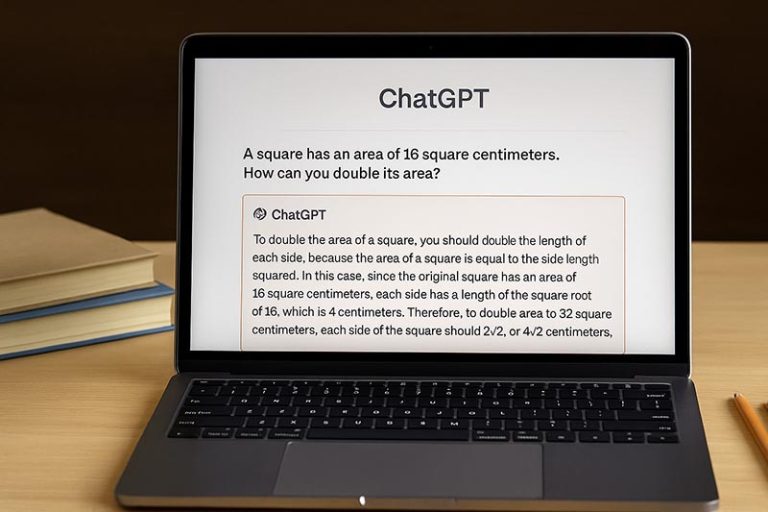

چتجیپیتی در مواجهه با مسئلهی مربع، توانست بر اساس دادههای آموزشی پاسخ دهد، اما وقتی پژوهشگران مسئلهی تازهای دربارهی دو برابر کردن مساحت مستطیل مطرح کردند، این سامانه پاسخ داد که راهحلی هندسی وجود ندارد. به گفتهی «ناداو مارکو» و «آندریاس استیلیانیدس»، این پاسخ نادرست نشان میدهد مدل در حال بداههپردازی بر پایهی تجربیات پیشین بوده است، نه صرفاً بازیابی دادههای ذخیرهشده.

دانشمندان تأکید کردند این رفتار شباهت زیادی به روش یادگیری انسان دارد؛ یعنی آزمون فرضیهها و خطاهای مشابه آنچه شاگردان سقراط مرتکب میشدند. آنان این پدیده را نوعی استفاده ناخودآگاه از مفهوم «منطقهی توسعهی مجاور» (ZPD) دانستند؛ جایی که یادگیرنده میان دانستههای فعلی و تواناییهای بالقوهاش در نوسان است. چنین مشاهدهای به گفته پژوهشگران میتواند دریچهای تازه برای درک نحوهی تفکر و استدلال در هوش مصنوعی باز کند.

هرچند محققان نسبت به تفسیر بیشازحد این یافتهها هشدار دادهاند، اما معتقدند نتایج میتواند مسیر تازهای برای آموزش و استفاده از هوش مصنوعی بگشاید. به باور آنان، دانشآموزان باید بیاموزند که اثباتهای تولیدشده توسط مدلهای زبانی معتبر نیستند مگر آنکه خودشان آنها را نقد و ارزیابی کنند. ترکیب چتجیپیتی با ابزارهایی مانند سامانههای هندسه پویا یا اثباتکنندههای قضیه نیز میتواند محیطهای آموزشی دیجیتال غنیتری ایجاد کند و فرصتهای تازهای برای پژوهش در حوزهی یادگیری ریاضی فراهم آورد.