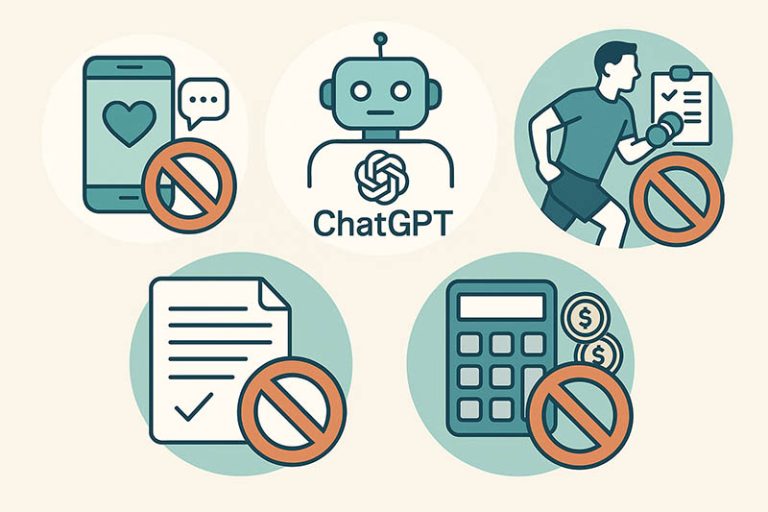

پیام جوان: یک گزارش تازه با هشدار درباره کاربردهای نامناسب هوش مصنوعی، بهویژه ChatGPT، تأکید میکند استفاده از این ابزار در حوزههای حساس میتواند به فریب، آسیب و تصمیمگیریهای نادرست منجر شود. در بخش نخست این گزارش آمده است که بهرهگیری از ChatGPT برای بهبود پروفایلهای دوستیابی یا پاسخدهی به پیامها به تحریف هویت واقعی منجر میشود و میتواند تجربه روابط عاطفی سالم را مخدوش کند.

در ادامه، استفاده از ChatGPT برای دریافت مشاوره حقوقی «خطرناک» توصیف شده است. به دلیل نبود دسترسی این ابزار به قوانین بهروز، ناتوانی در تحلیل زمینههای حقوقی و فقدان مسئولیتپذیری، اتکا به آن ممکن است عواقب جدی ایجاد کند؛ مسائلی که تنها وکلای دارای مجوز قادر به مدیریت آن هستند. همچنین هشدار داده شده که برنامههای ورزشی مبتنی بر هوش مصنوعی به دلیل ناتوانی در ارزیابی شرایط پزشکی فرد، میتوانند باعث آسیب جسمی شوند.

گزارش تأکید دارد که استفاده از ChatGPT برای تولید محتوای دانشگاهی نیز میتواند به سرقت ادبی، اطلاعات نادرست و تضعیف مهارتهای تفکر انتقادی منجر شود. بسیاری از دانشگاهها ارسال متون تولیدشده توسط هوش مصنوعی بهعنوان کار اصیل را تخلف علمی میدانند و برای آن مجازاتهایی در نظر گرفتهاند.

در بخش پایانی، متخصصان نسبت به استفاده از ChatGPT برای توصیههای مالی هشدار میدهند. نبود دسترسی این ابزار به دادههای بهروز، وضعیت مالی کاربران و قوانین مالیاتی، در کنار نگرانیهای حریم خصوصی، خطر تصمیمگیریهای نادرست و خسارات مالی را افزایش میدهد. گزارش نتیجه میگیرد که در حوزههای حساس، جایگزینی مشاوران انسانی با هوش مصنوعی اقدامی پرریسک است.